2024年全球大語言模型道德倫理風險分析及應對措施 正確認識大語言模型發展的兩面性【組圖】

行業主要上市公司:百川智能(A04400.SH)、昆侖萬維(300418.SZ)、拓維信息(002261.SZ)、浪潮信息(000977.SZ)、科大訊飛(002230.SZ)等

本文核心數據:針對大語言模型歧視、負面言論的解決方案;大語言模型在信息泄露領域的危害和緩解策略等

引言

大語言模型的迅猛發展為人工智能領域帶來了革命性的進步,它們在自然語言理解、文本生成、機器翻譯等方面展現出巨大的潛力和廣泛的應用前景。這些模型能夠提供個性化的用戶體驗,輔助決策制定,甚至在內容創作和教育等領域釋放人類的創造力。然而,這種技術進步的同時也帶來了雙面性。一方面,大語言模型依賴于大量的數據進行訓練,這可能涉及隱私泄露和數據安全問題;另一方面,模型可能會無意中學習并傳播偏見和不當內容,對社會價值和倫理道德造成沖擊。

風險一:歧視、負面言論

人工智能系統的訓練依賴于大量的數據集,而這些數據集往往來源于現實世界,可能帶有社會中存在的不平等現象和偏見。這可能導致大語言模型在處理信息時反映出不公正的社會觀念,甚至可能邊緣化弱勢群體或煽動仇恨和暴力。例如,數據集中可能存在的偏見,如基于種族或社會經濟地位的歧視,可能通過大語言模型的“技術中立”外衣被無意中強化和固化。為緩解這一問題,可采取的措施包括提升數據集的多樣性和包容性、加入偏見檢測與糾正機制、模型微調等,具體如下表所示:

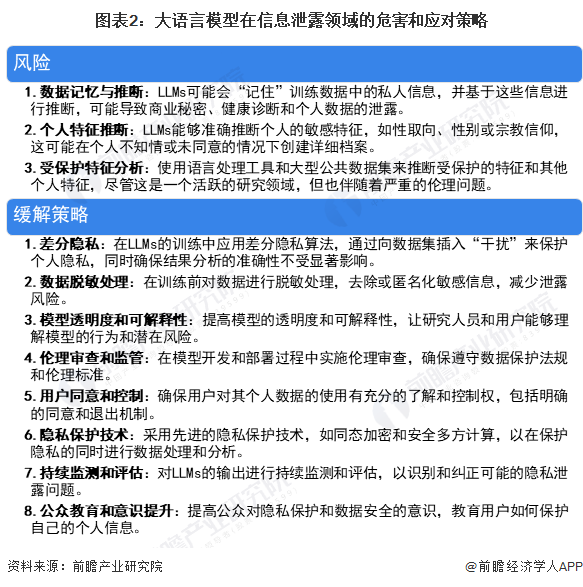

風險二:信息泄露的危害

大型語言模型(LLMs)在處理和生成信息時可能會無意中泄露私人或敏感信息,這引發了對隱私保護和數據安全的嚴重關切。以下是一些可能的風險和相應的緩解策略:

風險三:虛假信息危害

大型語言模型(LLMs)在信息處理和輸出方面存在的風險,以及由此產生的危害,是當前人工智能領域亟需解決的問題。以下總結了LLMs可能帶來的風險和相應的緩解策略:

風險四:惡意使用的風險

惡意使用大型語言模型(LLMs)的風險隨著技術的普及而增加,這些風險包括但不限于制造虛假信息、威脅網絡安全、提高犯罪效率等。以下是一些潛在的惡意使用風險和相應的應對措施:

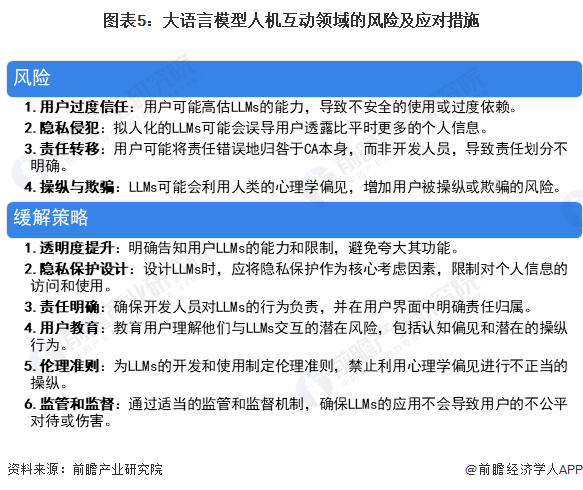

風險五:人機互動的危害

大型語言模型(LLMs)通過學習其訓練語料庫中的統計屬性來生成語言,這些語料庫通常來自網頁、書籍或其他文本資源。LLMs生成的文本不是直接輸出,而是通過概率分布抽樣得到的。這種生成方式使得LLMs可以用于各種應用,包括對話代理(CAs),如聊天機器人、教育助手和陪伴工具等。然而,LLMs在人機交互中的使用也帶來了一些特殊的風險:

更多本行業研究分析詳見前瞻產業研究院《中國大模型產業發展前景與投資戰略規劃分析報告》。

同時前瞻產業研究院還提供產業大數據、產業研究報告、產業規劃、園區規劃、產業招商、產業圖譜、智慧招商系統、行業地位證明、IPO咨詢/募投可研、專精特新小巨人申報、十五五規劃等解決方案。如需轉載引用本篇文章內容,請注明資料來源(前瞻產業研究院)。

更多深度行業分析盡在【前瞻經濟學人APP】,還可以與500+經濟學家/資深行業研究員交流互動。更多企業數據、企業資訊、企業發展情況盡在【企查貓APP】,性價比最高功能最全的企業查詢平臺。

前瞻產業研究院 - 深度報告 REPORTS

本報告前瞻性、適時性地對大模型產業的發展背景、供需情況、市場規模、競爭格局等行業現狀進行分析,并結合多年來大模型產業發展軌跡及實踐經驗,對大模型產業未來的發展...

如在招股說明書、公司年度報告中引用本篇文章數據,請聯系前瞻產業研究院,聯系電話:400-068-7188。

前瞻經濟學人

專注于中國各行業市場分析、未來發展趨勢等。掃一掃立即關注。